前沿信号 / 2026年4月 / 阅读时间约5分钟

当一家超大规模厂商把训练芯片与推理芯片彻底分开,它不是在发新品——是在宣告AI算力进入新范式。

信号描述:这件事是什么,为什么不普通

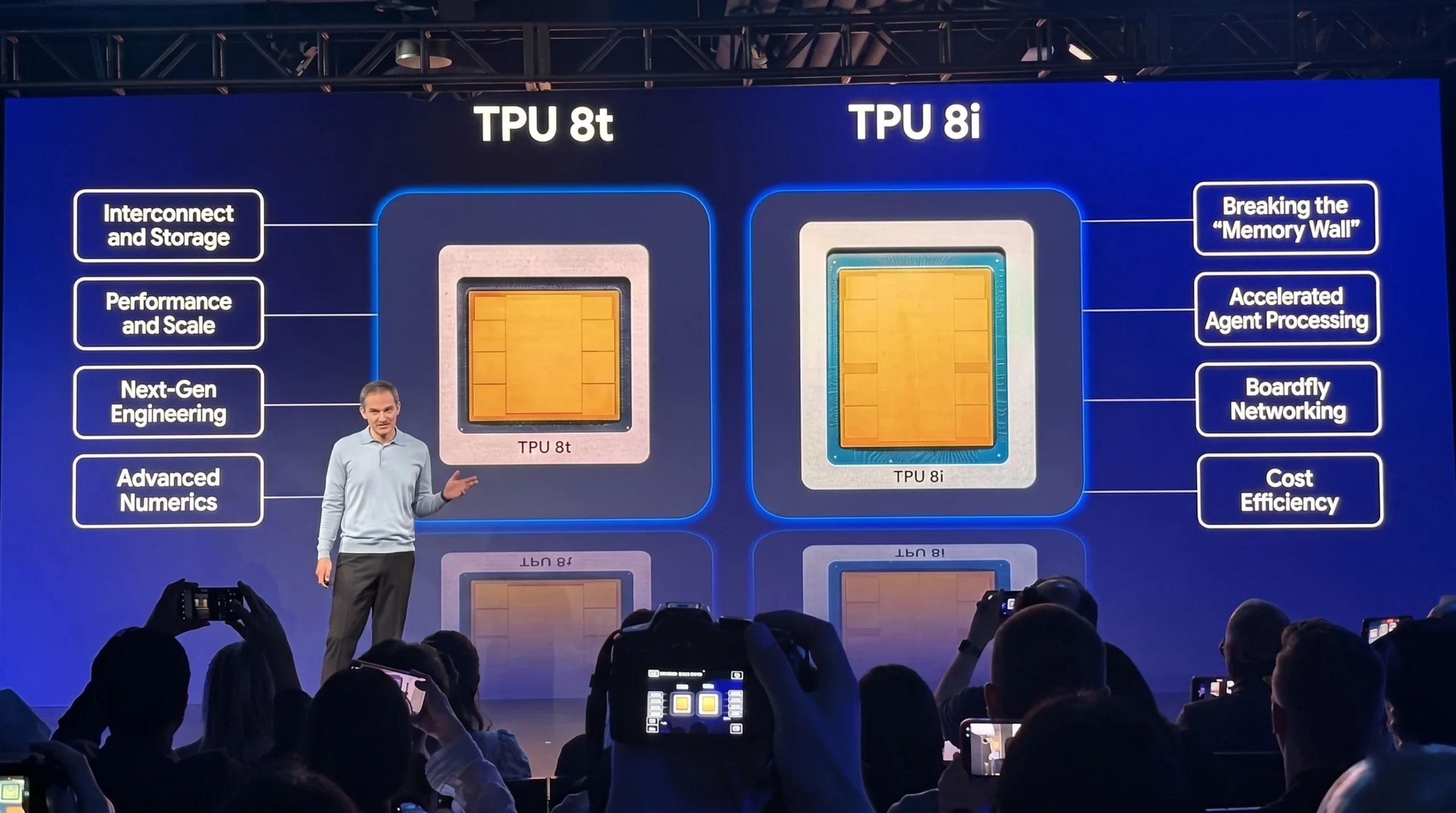

2026年4月22日,谷歌正式发布第八代自研AI芯片——面向训练的TPU 8t与面向推理的TPU 8i。这是谷歌第一次把训练芯片与推理芯片拆成两款独立产品,也是超大规模云厂商中第一次有人把「训推分离」明确写进产品路线图。

数量级的跃升是惊人的。单个TPU 8t超级芯片组可扩展至9600张芯片、2PB共享高带宽内存,整体架构提供121 ExaFlops计算能力;配合全新Virgo网络与JAX、Pathways软件栈,可在单个逻辑集群为多达100万张芯片提供近乎线性扩展。TPU 8i则把高带宽内存堆到288GB,叠加384MB片上SRAM——后者是上一代的3倍,直接对标当下MoE推理模型的KV Cache占用。

更关键的是跨芯片的三项整合。两款芯片首次运行在谷歌自研、基于Arm的Axion CPU主机上;整套系统采用第四代液冷以维持风冷无法实现的性能密度;每美元性能较上一代提升80%,每瓦性能达到Ironwood的2倍。谷歌完成了从CPU到加速器、从网络到液冷的整套垂直整合,并第一次把全栈整合的经济收益量化到左侧投资者可以引用的程度。

为什么值得左侧投资者认真对待

概念炒作还是结构性拐点?

投黑马的判断是:这次发布的真正意义不在于芯片参数,而在于谷歌用产品线告诉市场——AI算力的底层范式,正在从「通用加速器吃下所有负载」的时代,进入「训练与推理分岔」的新阶段。这是左侧投资者必须识别的第一个结构性拐点。

第一,训推分离不是产品差异化,而是对AI工作负载本质变化的被动响应。 过去十年GPU能通吃,是因为AI以训练为主导,需要的是吞吐量和可扩展带宽。但进入2026年,推理侧的规模已显著超过训练侧——智能体集群的协作迭代、MoE模型的KV Cache管理、延迟敏感的多轮对话——这些工作负载的优化方向与训练完全不同。TPU 8i为KV Cache量身定做的288GB HBM加384MB SRAM、减少超过50%最大网络直径的Boardfly拓扑、卸载全局操作的片上集体加速引擎(CAE),每一项都是训练芯片不会优先投入的设计。当推理规模大到必须被独立优化,训推分岔就是工程上的必然结果,而非营销层面的选择。

第二,全栈自研的经济性阈值已经被跨过。 市场过去几年持续讨论「超大规模厂商会不会自研替代英伟达」,真正做到商业闭环的只有谷歌一家。这次发布第一次把全栈垂直整合的经济收益公开量化:每美元性能+80%、每瓦性能翻倍,相同成本下可服务近2倍客户量。谷歌在自家数据中心部署推理的边际成本,第一次与英伟达方案拉开了可量化的结构性差距。这对英伟达不构成即刻的收入威胁,但提供了过去没有过的参照物:当一家超大规模厂商证明「全栈自研能把推理单位经济学压到足够低」,AWS、微软、Meta、字节、阿里复制这条路径的决策门槛会被显著降低。英伟达的护城河第一次进入可量化评估阶段——这是投黑马视角下本次信号最被市场低估的含义。

窗口判断:范式分岔的起点阶段,左侧窗口刚刚打开。 TPU 8t / 8i正式上市要到今年晚些时候,多数市场参与者仍按「GPU通吃」的旧框架给AI基础设施定价——这是左侧投资者最有利的时间差。

传导路径

第一层:直接受益与冲击方

最直接的受益者是谷歌云自身。训推分离叠加每美元性能+80%,意味着谷歌云在与AWS、Azure争夺大模型推理客户时,第一次拥有了可被工程师量化的成本优势。Anthropic已深度使用TPU训练Claude,这次发布将强化合作的路径依赖;谷歌云推理API定价在未来12个月具备明显下探空间。冲击方则是英伟达数据中心业务——不是短期收入层面,而是估值层面的「护城河评估框架」被迫重新校准。过去市场对英伟达的溢价,很大程度建立在「没有人能做出与CUDA匹配的替代方案」这一假设上;TPU 8i把性能、成本、功耗三个维度的差距都变成了可引用的公开数据。

第二层:结构性机会——MoE推理与智能体集群的专用硬件

训推分离打开的真正新赛道,是「为推理而生」的专用芯片。TPU 8i的设计目标非常明确:运行MoE模型、协调智能体集群、处理延迟敏感的多轮工作负载,这一画像与过去以Transformer稠密训练为主的AI算力需求截然不同。Groq、SambaNova、Cerebras、Tenstorrent等专做推理或非冯·诺伊曼架构的独立玩家,过去两年估值被英伟达统治叙事压制,随着「推理是一个独立赛道」的产品级背书出现,它们的商业化路径与估值模型都值得重新审视。国内寒武纪、壁仞、摩尔线程等若能在推理细分形成差异化定位,同样受益。投黑马视角下,左侧窗口已打开的是那些专门针对MoE推理与智能体工作负载做架构优化的早期公司——不是又一个「对标英伟达H100」的通用GPU。

第三层:基础设施受益——光互连、液冷与Arm CPU

TPU 8t / 8i把三个基础设施方向推到风口。第一是光路交换(OCS)——谷歌用OCS实现故障发生时无人干预的硬件重配置,这是超过97%有效吞吐量的关键;背后的光模块、硅光、共封装光学(CPO)玩家订单能见度将显著提升。第二是第四代液冷——液冷板、冷板快接头、CDU、液冷工质等配套环节的需求曲线将进一步陡峭化。第三是Arm在数据中心的渗透——Axion CPU的规模化部署是Arm架构在超大规模数据中心真正站稳脚跟的第一次标志性事件,对Ampere、Arm IP生态与国产Arm服务器方案都是持续利好。投黑马认为,无论训推分岔最终以谁为主导,这三条线都是必须被消耗的底层资源。

第四层:风险与泡沫提示

主要风险有三。其一,「训推分岔」叙事可能被资本市场放大为所有AI芯片标的的重估理由,进而形成估值泡沫——真正具备专用推理架构能力并拿到大客户合同的公司极为稀少,多数「AI推理概念」标的在2-3个季度内会被自然淘汰。其二,谷歌TPU高度依赖自家生态(JAX、Pathways、Axion),短期内无法对英伟达CUDA形成全面替代,若过早做出「护城河坍塌」式的极端判断,会低估CUDA软件生态的结构性厚度。其三,TPU 8t / 8i要到今年晚些时候才正式上市,产能爬坡、客户迁移与真实部署数据仍有不确定性,官方宣称的121 ExaFlops与100万芯片线性扩展是否在生产环境稳定兑现,需要6-9个月验证。

投黑马 · 信号解读

本期信号的本质不是「谷歌又一次追赶英伟达」,而是AI算力范式正式进入训推分岔的新阶段。训练与推理在工作负载、内存结构、网络拓扑、延迟要求上的差异,已大到通用加速器无法同时服务两者的程度。谷歌用一次产品发布公开承认这件事,这是左侧投资者需要识别的底层拐点:未来3-5年,AI基础设施的价值分布会沿着「训练专用/推理专用/全栈自研」三条线重新切分,而非集中在单一芯片架构。

当前最值得关注的是「专用推理架构玩家」这一细分层。TPU 8i不对外独立售卖,但它证明了为MoE推理与智能体工作负载做专门设计具备80%量级的经济收益。投黑马判断,Groq、SambaNova、Cerebras、Tenstorrent等独立推理芯片公司,以及光互连、第四代液冷、Arm服务器CPU赛道上具备差异化能力的早期标的,是当前估值尚未充分反映范式切换的左侧洼地。

左侧投资者应追踪三个具体信号:第一,TPU 8i商用后谷歌云推理API定价的调整幅度——若价格在未来2-3个季度下探超过30%,将触发AWS、Azure、Oracle Cloud在推理端的连锁应对,是判断「训推分岔」真实经济影响的最直接数据;第二,除谷歌之外的超大规模厂商(AWS Trainium2 / Inferentia、微软Maia、Meta MTIA)第三方性能基准的发布进度——当第二家、第三家厂商公开出可对比的全栈自研数据,英伟达估值框架才会发生系统性重估;第三,光路交换(OCS)与共封装光学(CPO)赛道的订单能见度,特别是海外光模块龙头的季度指引与国产CPO早期公司的客户合同规模——这是「训推分岔」传导至基础设施层最可验证的变量。── 投黑马研究团队